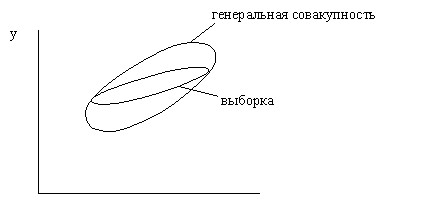

После того как уравнение регрессии построено и с помощью коэффициента детерминации оценена его точность, остается открытым вопрос за счет чего достигнута эта точность и соответственно можно ли этому уравнению доверять. Дело в том, что уравнение регрессии строилось не по генеральной совокупности, которая неизвестна, а по выборке из нее. Точки из генеральной совокупности попадают в выборку случайным образом, по этому в соответствии с теорией вероятности среди прочих случаев возможен вариант, когда выборка из “широкой” генеральной совокупности окажется “узкой” (рис. 15).

Рис. 15. Возможный вариант попадания точек в выборку из генеральной совокупности.

В этом случае:

а) уравнение регрессии, построенное по выборке, может значительно отличаться от уравнения регрессии для генеральной совокупности, что приведет к ошибкам прогноза;

б) коэффициент детерминации и другие характеристики точности окажутся неоправданно высокими и будут вводить в заблуждение о прогнозных качествах уравнения.

В предельном случае не исключен вариант, когда из генеральной совокупности представляющей собой облако с главной осью параллельной горизонтальной оси (отсутствует связь между переменными) за счет случайного отбора будет получена выборка, главная ось которой окажется наклоненной к оси. Таким образом, попытки прогнозировать очередные значения генеральной совокупности опираясь на данные выборки из нее чреваты не только ошибками в оценке силы и направления связи между зависимой и независимой переменными, но и опасностью найти связь между переменными там, где на самом деле ее нет.

В условиях отсутствия информации обо всех точках генеральной совокупности единственный способ уменьшить ошибки в первом случае заключается в использовании при оценке коэффициентов уравнения регрессии метода, обеспечивающего их несмещенность и эффективность. А вероятность наступления второго случая может быть значительно снижена благодаря тому, что априори известно одно свойство генеральной совокупности с двумя независимыми друг от друга переменными – в ней отсутствует именно эта связь. Достигается это снижение за счет проверки статистической значимости полученного уравнения регрессии.

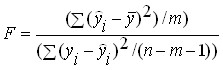

Один из наиболее часто используемых вариантов проверки заключается в следующем. Для полученного уравнения регрессии определяется ![]() -статистика — характеристика точности уравнения регрессии, представляющая собой отношение той части дисперсии зависимой переменной которая объяснена уравнением регрессии к необъясненной (остаточной) части дисперсии. Уравнение для определения

-статистика — характеристика точности уравнения регрессии, представляющая собой отношение той части дисперсии зависимой переменной которая объяснена уравнением регрессии к необъясненной (остаточной) части дисперсии. Уравнение для определения ![]() -статистики в случае многомерной регрессии имеет вид:

-статистики в случае многомерной регрессии имеет вид:

где:  — объясненная дисперсия — часть дисперсии зависимой переменной Y которая объяснена уравнением регрессии;

— объясненная дисперсия — часть дисперсии зависимой переменной Y которая объяснена уравнением регрессии;

— остаточная дисперсия — часть дисперсии зависимой переменной Y которая не объяснена уравнением регрессии, ее наличие является следствием действия случайной составляющей;

— остаточная дисперсия — часть дисперсии зависимой переменной Y которая не объяснена уравнением регрессии, ее наличие является следствием действия случайной составляющей;

![]() — число точек в выборке;

— число точек в выборке;

![]() — число переменных в уравнении регрессии.

— число переменных в уравнении регрессии.

Как видно из приведенной формулы, дисперсии определяются как частное от деления соответствующей суммы квадратов на число степеней свободы. Число степеней свободы это минимально необходимое число значений зависимой переменной, которых достаточно для получения искомой характеристики выборки и которые могут свободно варьироваться с учетом того, что для этой выборки известны все другие величины, используемые для расчета искомой характеристики.

Для получения остаточной дисперсии необходимы коэффициенты уравнения регрессии. В случае парной линейной регрессии коэффициентов два, по этому в соответствии с формулой (принимая ![]() ) число степеней свободы равно

) число степеней свободы равно ![]() . Имеется в виду, что для определения остаточной дисперсии достаточно знать коэффициенты уравнения регрессии и только

. Имеется в виду, что для определения остаточной дисперсии достаточно знать коэффициенты уравнения регрессии и только ![]() значений зависимой переменной из выборки. Оставшиеся два значения могут быть вычислены на основании этих данных, а значит, не являются свободно варьируемыми.

значений зависимой переменной из выборки. Оставшиеся два значения могут быть вычислены на основании этих данных, а значит, не являются свободно варьируемыми.

Для вычисления объясненной дисперсии значений зависимой переменной вообще не требуются, так как ее можно вычислить, зная коэффициенты регрессии при независимых переменных и дисперсию независимой переменной. Для того чтобы убедиться в этом, достаточно вспомнить приводившееся ранее выражение ![]() . По этому число степеней свободы для остаточной дисперсии равно числу независимых переменных в уравнении регрессии (для парной линейной регрессии

. По этому число степеней свободы для остаточной дисперсии равно числу независимых переменных в уравнении регрессии (для парной линейной регрессии ![]() ).

).

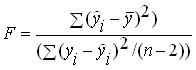

В результате ![]() -критерий для уравнения парной линейной регрессии определяется по формуле:

-критерий для уравнения парной линейной регрессии определяется по формуле:

.

.

В теории вероятности доказано, что ![]() -критерий уравнения регрессии, полученного для выборки из генеральной совокупности у которой отсутствует связь между зависимой и независимой переменной имеет распределение Фишера, достаточно хорошо изученное. Благодаря этому для любого значения

-критерий уравнения регрессии, полученного для выборки из генеральной совокупности у которой отсутствует связь между зависимой и независимой переменной имеет распределение Фишера, достаточно хорошо изученное. Благодаря этому для любого значения ![]() -критерия можно рассчитать вероятность его появления и наоборот, определить то значение

-критерия можно рассчитать вероятность его появления и наоборот, определить то значение ![]() -критерия которое он не сможет превысить с заданной вероятностью.

-критерия которое он не сможет превысить с заданной вероятностью.

Для осуществления статистической проверки значимости уравнения регрессии формулируется нулевая гипотеза об отсутствии связи между переменными (все коэффициенты при переменных равны нулю) и выбирается уровень значимости ![]() .

.

Уровень значимости – это допустимая вероятность совершить ошибку первого рода – отвергнуть в результате проверки верную нулевую гипотезу. В рассматриваемом случае совершить ошибку первого рода означает признать по выборке наличие связи между переменными в генеральной совокупности, когда на самом деле ее там нет.

Обычно уровень значимости принимается равным 5% или 1%. Чем выше уровень значимости (чем меньше ![]() ), тем выше уровень надежности теста, равный

), тем выше уровень надежности теста, равный ![]() , т.е. тем больше шанс избежать ошибки признания по выборке наличия связи у генеральной совокупности на самом деле несвязанных между собой переменных. Но с ростом уровня значимости возрастает опасность совершения ошибки второго рода – отвергнуть верную нулевую гипотезу, т.е. не заметить по выборке имеющуюся на самом деле связь переменных в генеральной совокупности. По этому, в зависимости от того, какая ошибка имеет большие негативные последствия, выбирают тот или иной уровень значимости.

, т.е. тем больше шанс избежать ошибки признания по выборке наличия связи у генеральной совокупности на самом деле несвязанных между собой переменных. Но с ростом уровня значимости возрастает опасность совершения ошибки второго рода – отвергнуть верную нулевую гипотезу, т.е. не заметить по выборке имеющуюся на самом деле связь переменных в генеральной совокупности. По этому, в зависимости от того, какая ошибка имеет большие негативные последствия, выбирают тот или иной уровень значимости.

Для выбранного уровня значимости по распределению Фишера определяется табличное значение ![]() вероятность превышения, которого в выборке мощностью

вероятность превышения, которого в выборке мощностью ![]() , полученной из генеральной совокупности без связи между переменными, не превышает уровня значимости.

, полученной из генеральной совокупности без связи между переменными, не превышает уровня значимости. ![]() сравнивается с фактическим значением критерия для регрессионного уравнения

сравнивается с фактическим значением критерия для регрессионного уравнения ![]() .

.

Если выполняется условие ![]() , то ошибочное обнаружение связи со значением

, то ошибочное обнаружение связи со значением ![]() -критерия равным или большим

-критерия равным или большим ![]() по выборке из генеральной совокупности с несвязанными между собой переменными будет происходить с вероятностью меньшей чем уровень значимости. В соответствии с правилом “очень редких событий не бывает”, приходим к выводу, что установленная по выборке связь между переменными имеется и в генеральной совокупности, из которой она получена.

по выборке из генеральной совокупности с несвязанными между собой переменными будет происходить с вероятностью меньшей чем уровень значимости. В соответствии с правилом “очень редких событий не бывает”, приходим к выводу, что установленная по выборке связь между переменными имеется и в генеральной совокупности, из которой она получена.

Если же оказывается ![]() , то уравнение регрессии статистически не значимо. Иными словами существует реальная вероятность того, что по выборке установлена не существующая в реальности связь между переменными. К уравнению, не выдержавшему проверку на статистическую значимость, относятся так же, как и к лекарству с истекшим сроком годнос-

, то уравнение регрессии статистически не значимо. Иными словами существует реальная вероятность того, что по выборке установлена не существующая в реальности связь между переменными. К уравнению, не выдержавшему проверку на статистическую значимость, относятся так же, как и к лекарству с истекшим сроком годнос-

ти – такие лекарства не обязательно испорчены, но раз нет уверенности в их качестве, то их предпочитают не использовать. Это правило не уберегает от всех ошибок, но позволяет избежать наиболее грубых, что тоже достаточно важно.

Второй вариант проверки, более удобный в случае использования электронных таблиц, это сопоставление вероятности появления полученного значения ![]() -критерия с уровнем значимости. Если эта вероятность оказывается ниже уровня значимости

-критерия с уровнем значимости. Если эта вероятность оказывается ниже уровня значимости ![]() , значит уравнение статистически значимо, в противном случае нет.

, значит уравнение статистически значимо, в противном случае нет.

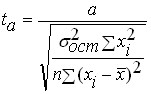

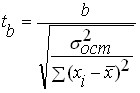

После того как выполнена проверка статистической значимости регрессионного уравнения в целом полезно, особенно для многомерных зависимостей осуществить проверку на статистическую значимость полученных коэффициентов регрессии. Идеология проверки такая же как и при проверке уравнения в целом но в качестве критерия используется ![]() -критерий Стьюдента, определяемый по формулам:

-критерий Стьюдента, определяемый по формулам:

и

и

где: ![]() ,

, ![]() — значения критерия Стьюдента для коэффициентов

— значения критерия Стьюдента для коэффициентов ![]() и

и ![]() соответственно;

соответственно;

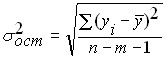

— остаточная дисперсия уравнения регрессии;

— остаточная дисперсия уравнения регрессии;

![]() — число точек в выборке;

— число точек в выборке;

![]() — число переменных в выборке, для парной линейной регрессии

— число переменных в выборке, для парной линейной регрессии ![]() .

.

Полученные фактические значения критерия Стьюдента сравниваются с табличными значениями ![]() , полученными из распределения Стьюдента. Если оказывается, что

, полученными из распределения Стьюдента. Если оказывается, что ![]() , то соответствующий коэффициент статистически значим, в противном случае нет. Второй вариант проверки статистической значимости коэффициентов – определить вероятность появления критерия Стьюдента

, то соответствующий коэффициент статистически значим, в противном случае нет. Второй вариант проверки статистической значимости коэффициентов – определить вероятность появления критерия Стьюдента ![]() и сравнить с уровнем значимости

и сравнить с уровнем значимости ![]() .

.

Для переменных, чьи коэффициенты оказались статистически не значимы, велика вероятность того, что их влияние на зависимую переменную в генеральной совокупности вообще отсутствует. По этому или необходимо увеличить число точек в выборке, тогда возможно коэффициент станет статистически значимым и заодно уточнится его значение, или в качестве независимых переменных найти другие, более тесно связанные с зависимой переменной. Точность прогнозирования при этом в обоих случаях возрастет.

В качестве экспрессного метода оценки значимости коэффициентов уравнения регрессии можно применять следующее правило – если критерий Стьюдента больше 3, то такой коэффициент, как правило, оказывается статистически значим. А вообще считается, что для получения статистически значимых уравнений регрессии необходимо, чтобы выполнялось условие ![]() .

.

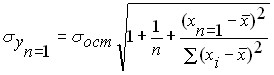

Стандартная ошибка прогнозирования по полученному уравнению регрессии неизвестного значения ![]() при известном

при известном ![]() оценивают по формуле:

оценивают по формуле:

Таким образом прогноз с доверительной вероятностью 68% может быть представлен в виде:

![]() .

.

В случае если требуется иная доверительная вероятность ![]() , то для уровня значимости

, то для уровня значимости ![]() необходимо найти критерий Стьюдента

необходимо найти критерий Стьюдента ![]() и доверительный интервал для прогноза с уровнем надежности

и доверительный интервал для прогноза с уровнем надежности ![]() будет равен

будет равен ![]() .

.

Прогнозирование многомерных и нелинейных зависимостей

В случае если прогнозируемая величина зависит от нескольких независимых переменных, то в этом случае имеется многомерная регрессия вида:

![]()

где: ![]() — коэффициенты регрессии, описывающие влияние переменных

— коэффициенты регрессии, описывающие влияние переменных ![]() на прогнозируемую величину.

на прогнозируемую величину.

Методика определения коэффициентов регрессии не отличается от парной линейной регрессии, особенно при использовании электронной таблицы, так как там применяется одна и та же функция и для парной и для многомерной линейной регрессии. При этом желательно чтобы между независимыми переменными отсутствовали взаимосвязи, т.е. изменение одной переменной не сказывалось на значениях других переменных. Но это требование не является обязательным, важно чтобы между переменными отсутствовали функциональные линейные зависимости. Описанные выше процедуры проверки статистической значимости полученного уравнения регрессии и его отдельных коэффициентов, оценка точности прогнозирования остается такой же как и для случая парной линейной регрессии. В тоже время применение многомерных регрессий вместо парной обычно позволяет при надлежащем выборе переменных существенно повысить точность описания поведения зависимой переменной, а значит и точность прогнозирования.

Кроме этого уравнения многомерной линейной регрессии позволяют описать и нелинейную зависимость прогнозируемой величины от независимых переменных. Процедура приведения нелинейного уравнения к линейному виду называется линеаризацией. В частности если эта зависимость описывается полиномом степени отличной от 1, то, осуществив замену переменных со степенями отличными от единицы на новые переменные в первой степени, получаем задачу многомерной линейной регрессии вместо нелинейной. Так, например если влияние независимой переменной описывается параболой вида

![]()

то замена ![]() позволяет преобразовать нелинейную задачу к многомерной линейной вида

позволяет преобразовать нелинейную задачу к многомерной линейной вида

![]()

Так же легко могут быть преобразованы нелинейные задачи у которых нелинейность возникает вследствие того, что прогнозируемая величина зависит от произведения независимых переменных. Для учета такого влияния необходимо ввести новую переменную равную этому произведению.

В тех случаях, когда нелинейность описывается более сложными зависимостями, линеаризация возможна за счет преобразования координат. Для этого рассчитываются значения ![]() и строятся графики зависимости исходных точек в различных комбинациях преобразованных переменных. Та комбинация преобразованных координат или преобразованных и не преобразованных координат, в которой зависимость ближе всего к прямой линии подсказывает замену переменных которая приведет к преобразованию нелинейной зависимости к линейному виду. Например, нелинейная зависимость вида

и строятся графики зависимости исходных точек в различных комбинациях преобразованных переменных. Та комбинация преобразованных координат или преобразованных и не преобразованных координат, в которой зависимость ближе всего к прямой линии подсказывает замену переменных которая приведет к преобразованию нелинейной зависимости к линейному виду. Например, нелинейная зависимость вида

![]()

превращается в линейную вида

![]()

где: ![]() ,

, ![]() и

и ![]() .

.

Полученные коэффициенты регрессии для преобразованного уравнения остаются несмещенными и эффективными, но проверка статистической значимости уравнения и коэффициентов невозможна

Проверка обоснованности применения метода наименьших квадратов

Применение метода наименьших квадратов обеспечивает эффективность и несмещенность оценок коэффициентов уравнения регрессии при соблюдении следующих условий (условий Гауса-Маркова):

1. ![]()

2. ![]()

3. значения ![]() не зависят друг от друга

не зависят друг от друга

4. значения ![]() не зависят от независимых переменных

не зависят от независимых переменных

Наиболее просто можно проверить соблюдение этих условий путем построения графиков остатков ![]() в зависимости от

в зависимости от ![]() , затем от независимой (независимых) переменных. Если точки на этих графиках расположены в коридоре расположенном симметрично оси абсцисс и в расположении точек не просматриваются закономерности, то условия Гауса-Маркова выполнены и возможности повысить точность уравнения регрессии отсутствуют. Если это не так, то существует возможность существенно повысить точность уравнения и для этого необходимо обратиться к специальной литературе.

, затем от независимой (независимых) переменных. Если точки на этих графиках расположены в коридоре расположенном симметрично оси абсцисс и в расположении точек не просматриваются закономерности, то условия Гауса-Маркова выполнены и возможности повысить точность уравнения регрессии отсутствуют. Если это не так, то существует возможность существенно повысить точность уравнения и для этого необходимо обратиться к специальной литературе.